機器之心報道

編輯:維度

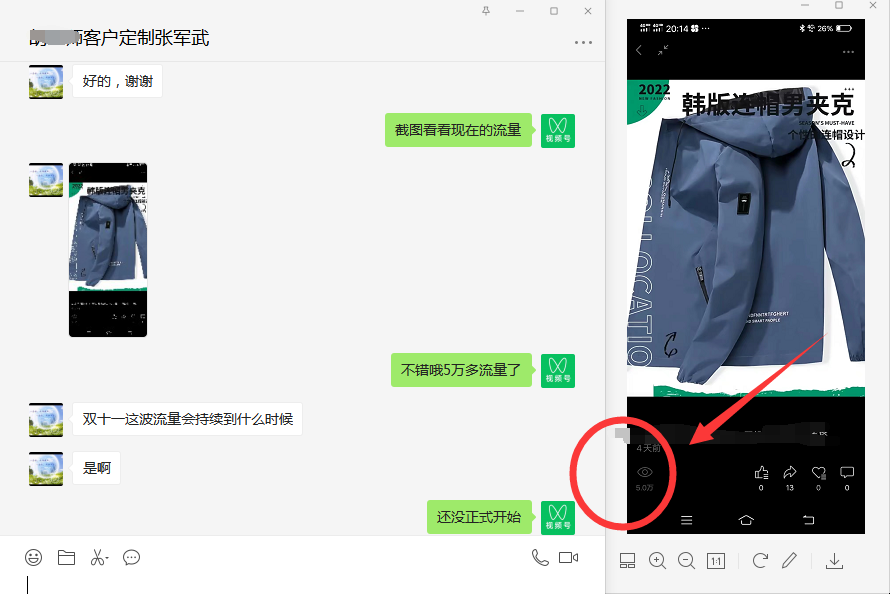

人臉風格遷移出現新玩法!捷克理工大學聯合 Snap 公司創建了一個用于視頻中人臉風格實時遷移的框架,既不需要大型數據集和冗長訓練周期,更能夠在移動端運行。

今年,人臉視頻特效在全球又大火特火了一把。年初的「螞蟻牙黑」(人臉唱歌),還有不久前讓老照片動起來的特效,效果都十分驚艷。

風格遷移一直是圖像領域的熱門方向。那么在視頻上做實時人臉畫風遷移效果怎么樣呢?

是這樣的:

當然,視頻畫風遷移并不是什么新鮮技術了。但這項研究最大的特點在于:移動端、實時,由布拉格捷克理工大學和 Snap 公司的研究者聯合完成。目前已經放出了完整論文,相關代碼將于下月發布。

項目地址:https://ondrejtexler.github.io/faceblit/

論文地址:https://ondrejtexler.github.io/res/faceblit-paper.pdf

具體而言,研究者提出了一種基于實例的實時視頻人臉風格遷移框架 FaceBlit,該框架通過語義上有意義的方式保留了風格的紋理細節,也就是說,用于描繪特定風格特征的筆畫出現在目標圖像的適當位置。

與以往風格遷移方法相比,該框架不僅保留了目標對象(target subject)的身份,而且不需要大型數據集和冗長訓練周期即可實現實時運行。

為此,研究者修改了 Fi er 等人(2017 年)的人臉風格化 pipeline,這樣快速生成一組指引通道(guiding channel),不僅可以保留了目標對象的身份,還兼容 S kora 等人(2019 年)的基于 patch 合成算法的速度更快變體。

得益于這些方法上的改進,研究者創建了首個即使在移動端,也可以將單個肖像的藝術風格實時遷移至目標視頻中人臉的系統框架