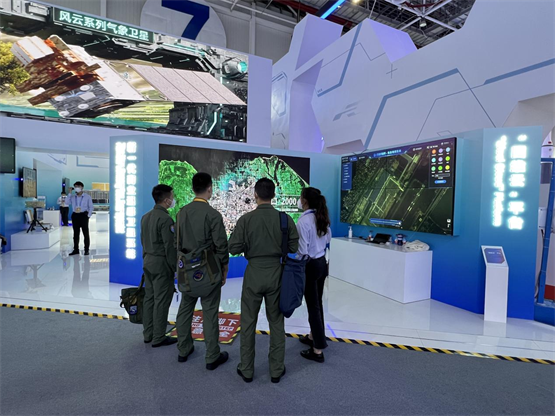

大規(guī)模網(wǎng)絡(luò)攻擊曾倒逼殺毒軟件的誕生,人工智能時(shí)代針對(duì)算法漏洞這一“新型病毒”,又該如何“殺毒”?記者9日從RealAI(瑞萊智慧)獲悉,他們推出針對(duì)算法模型本身安全的檢測(cè)平臺(tái),相當(dāng)于人工智能時(shí)代的“殺毒軟件”。

RealAI是一個(gè)孵化自清華大學(xué)人工智能研究院的創(chuàng)新團(tuán)隊(duì),相關(guān)研究成果已被FoolBox等開源軟件收錄為標(biāo)準(zhǔn)。RealAI還與清華方面組成戰(zhàn)隊(duì),在人工智能領(lǐng)域多項(xiàng)國(guó)際大賽中斬獲冠軍。

RealAI的首席執(zhí)行官田天介紹,團(tuán)隊(duì)最新推出的RealSafe人工智能安全平臺(tái)可以提供從測(cè)評(píng)到防御完整的解決方案,快速緩解對(duì)抗樣本攻擊威脅。

由于人工智能或可實(shí)現(xiàn)對(duì)人腦的替代,因此,在每一輪人工智能發(fā)展浪潮中,人們都非常關(guān)注其安全問題和倫理影響。業(yè)內(nèi)專家認(rèn)為,當(dāng)前針對(duì)“人工智能安全”的定義主要來源于“賦能安全應(yīng)用”和“防范技術(shù)風(fēng)險(xiǎn)”兩個(gè)層面。

其中,后者是對(duì)現(xiàn)階段由于人工智能技術(shù)不成熟以及惡意應(yīng)用所導(dǎo)致的安全風(fēng)險(xiǎn),包括模型缺陷、算法不可解釋性、數(shù)據(jù)強(qiáng)依賴性等,本質(zhì)上由人工智能“技術(shù)短板”所致,是限制人工智能發(fā)展最明顯的“軟肋”。而在中國(guó)信息通信研究院2018年編制的《人工智能安全白皮書》中,“算法安全”是人工智能六大安全風(fēng)險(xiǎn)之一。白皮書還指出“對(duì)抗樣本攻擊誘使算法識(shí)別出現(xiàn)誤判漏判”這一算法模型缺陷為算法安全的重要風(fēng)險(xiǎn)項(xiàng)。

田天解釋,對(duì)抗樣本原本是機(jī)器學(xué)習(xí)模型的一個(gè)有趣現(xiàn)象,通過在源數(shù)據(jù)上增加人類難以通過感官辨識(shí)到的細(xì)微改變,讓機(jī)器學(xué)習(xí)模型接受并做出錯(cuò)誤的分類決定。但是經(jīng)過不斷升級(jí)演化,對(duì)抗樣本攻擊已不僅停留在數(shù)字世界。

“在路面上粘貼對(duì)抗樣本貼紙模仿合并條帶誤導(dǎo)自動(dòng)駕駛汽車拐進(jìn)逆行車道、佩戴對(duì)抗樣本生成的眼鏡輕易破解手機(jī)面部解鎖、胸前張貼對(duì)抗樣本貼紙即可實(shí)現(xiàn)隱身……”他舉例說,對(duì)抗樣本會(huì)導(dǎo)致人工智能系統(tǒng)被攻擊和惡意侵?jǐn)_,成為威脅到人工智能系統(tǒng)的“人工智能病毒”,在人臉識(shí)別、自動(dòng)駕駛等領(lǐng)域或?qū)⒃斐呻y以挽回的損失。

然而,業(yè)界對(duì)于如何評(píng)價(jià)算法模型的安全性并沒有清楚的定義,對(duì)抗樣本等算法漏洞檢測(cè)存在較高的技術(shù)壁壘,目前市面上缺乏自動(dòng)化檢測(cè)評(píng)估工具。

田天表示,相較于目前常見的開源工具需要自行部署、編寫代碼,RealSafe平臺(tái)支持零編碼在線測(cè)評(píng),用戶只需提供相應(yīng)的數(shù)據(jù)即可在線完成評(píng)估。為幫助用戶提高對(duì)模型安全性的概念,該平臺(tái)根據(jù)模型在對(duì)抗樣本攻擊下的表現(xiàn)進(jìn)行評(píng)分,還提供模型安全性升級(jí)服務(wù),支持五種去除對(duì)抗噪聲的通用防御方法。部分第三方的人臉比對(duì)API通過使用RealSafe平臺(tái)的防御方案加固后,安全性可提高40%以上。

“推出安全檢測(cè)平臺(tái)是規(guī)避風(fēng)險(xiǎn)的一條路徑,未來還需要聯(lián)合各界力量共同推動(dòng)人工智能安全相關(guān)的國(guó)家標(biāo)準(zhǔn)、行業(yè)標(biāo)準(zhǔn)、聯(lián)盟標(biāo)準(zhǔn)的制定,為人工智能產(chǎn)品安全評(píng)估評(píng)測(cè)的統(tǒng)一參考。”他說。(完)

關(guān)鍵詞: